최초/최신 : 비용을 줄이는 LLM(대규모 언어 모델) Prompt Tuning

Online Course.

비용을 줄이는 LLM(대규모 언어 모델)

Prompt Tuning

-

Overfitting을 최소화할 수 있는

Prompt TuningPrompt Tuning으로 LLM을 학습하면서 모델 사이즈가 가지고 있던 메모리 부담 감소

-

비용 절감 노하우 1.

허깅페이스를 활용한 저비용 LLM 학습Deepspeed/Accelerate 라이브러리를 활용하여 기존 파인튜닝 대비 낮은 비용으로 LLM 학습

-

비용 절감 노하우 2.

하이퍼파라미터 영역 설정 방법 학습Task 별 복잡한 하이퍼파라미터 영역 설정에 대한 노하우를 배우며 모델 학습 방법의 시야 확장

ChatGPT를 시작으로 쏟아져 나오고 있는

LLM(대규모 언어모델) 개발 전쟁

(LLM : Large Language Model)

이 4개의 대규모 언어모델이 가지고 있는 공통점을 알고 계시나요?

바로 파인 튜닝(Fine -Tuning)을 통해 만들어진 모델입니다.

하지만...

LLM 파인튜닝을 위한 GPU 비용의 부담으로

모델 개발에 어려움을 겪고 있습니다.

이 문제 해결을 위해 NLP Research & Engineer는

’Prompt Tuning’ 을 제안하고 있습니다.

Prompt Tuning 또는 PEFT(Parameter Efficient Fine Tuning) 방식은

소수의 추가 된 모델 파라미터만 Fine Tuning 합니다.

그래서 사전 학습된 언어 모델(PLM)을 다양한 Downstream Application에

효율적으로 적용할 수 있으며 계산 및 저장 비용을 크게 절감할 수 있습니다.

Prompt Tuning은 3가지 장점을 가지고 있습니다!

같은 GPU 자원으로 더 큰 모델을 학습할 수 있는 Prompt Tuning

하드웨어 : Single A100 8GB GPU with CPU RAM above 64GB

A 100 GPU를 가지고 Fine Tuning 할 때 7B 이상의 모델은 GPU Out of Memory가 발생하여

학습 자체가 불가하지만, Prompt Tuning을 활용한다면 7B는 물론 12B 모델까지 충분히 학습 가능합니다!

파인튜닝 대비 400% 이상 저렴한 학습비용

동일한 LLaMa 7B 모델을 Fine-Tuning 한 결과와 비교하였을 때 Prompt Tuning 방법 중 하나인

PEFT(Parameter Efficient Fine Tuning)를 사용하면 400% 이상의 비용 효율을 볼 수 있습니다!

실무에서 더 똑똑하게 LLM을 학습시키고 싶으신가요?

그렇다면 Prompt Tuning은 선택이 아닌 필수입니다!

Point 1

최신 LLM 트랜드 학습

최근 등장하고 있는 다양한 LLM(Large Language Model)이

나오기까지의 모델의 발전 과정을 학습합니다.

Transformer부터 Alpaca까지의 LLM 모델 발전 역사와

주요 LLM 모델들이자 학습 방법론이 공개 된 GPT-3, LLaMA, InstructGPT, Alpaca 모델들을

직접 케이스 스터디하며 LLM 모델에 대한 이해를 한 층 높일 수 있습니다.

Point 2

허깅페이스 라이브러리를 활용한

LLM Prompt Tuning 학습 기법

GPU 자원을 더 효과적으로 사용할 수 있는 전반적인 방법을 학습하고

허깅페이스 라이브러리인 Deepspeed와 Accelerate를 이해합니다.

Point 3

Prompt Tuning & PEFT (Parameter Efficient Fine Tuning)

적은 GPU 자원으로 크기가 큰 모델을 효과적으로 학습할 수 있는 방법을 배우고

NLI, Sentiment Analysis, QA, Summerization 등 다양한 NLP Task에서 모델 실습을 진행합니다.

Step 01

먼저 Prompt Tuning과 PEFT 기법이 출현한 배경 및

전반적인 개요에 대해 학습합니다.

Step 02

여러 Prompt Tuning 방법론을 활용하여 NLI, Sentiment Analysis, QA,

Summerization Task에 모델 실습을 진행합니다.

-

실습 01. Prefix TuningPrefix Tuning을 학습해보고, NLI Task에 적용하여

실습 01. Prefix TuningPrefix Tuning을 학습해보고, NLI Task에 적용하여

모델을 학습합니다. -

실습 02. Prompt TuningPrefix Tuning을 Prompt Tuning을 학습해보고,

실습 02. Prompt TuningPrefix Tuning을 Prompt Tuning을 학습해보고,

Sentiment Analysis Task에 적용하여 모델을 학습합니다.

-

실습 03. P-TuningP-Tuning을 학습해보고, Question Answering Task에 적용하여

실습 03. P-TuningP-Tuning을 학습해보고, Question Answering Task에 적용하여

모델을 학습합니다. -

실습 04. LoRALoRA를 학습해보고, Summerization Task에 적용하여

실습 04. LoRALoRA를 학습해보고, Summerization Task에 적용하여

모델을 학습합니다.

Step 03

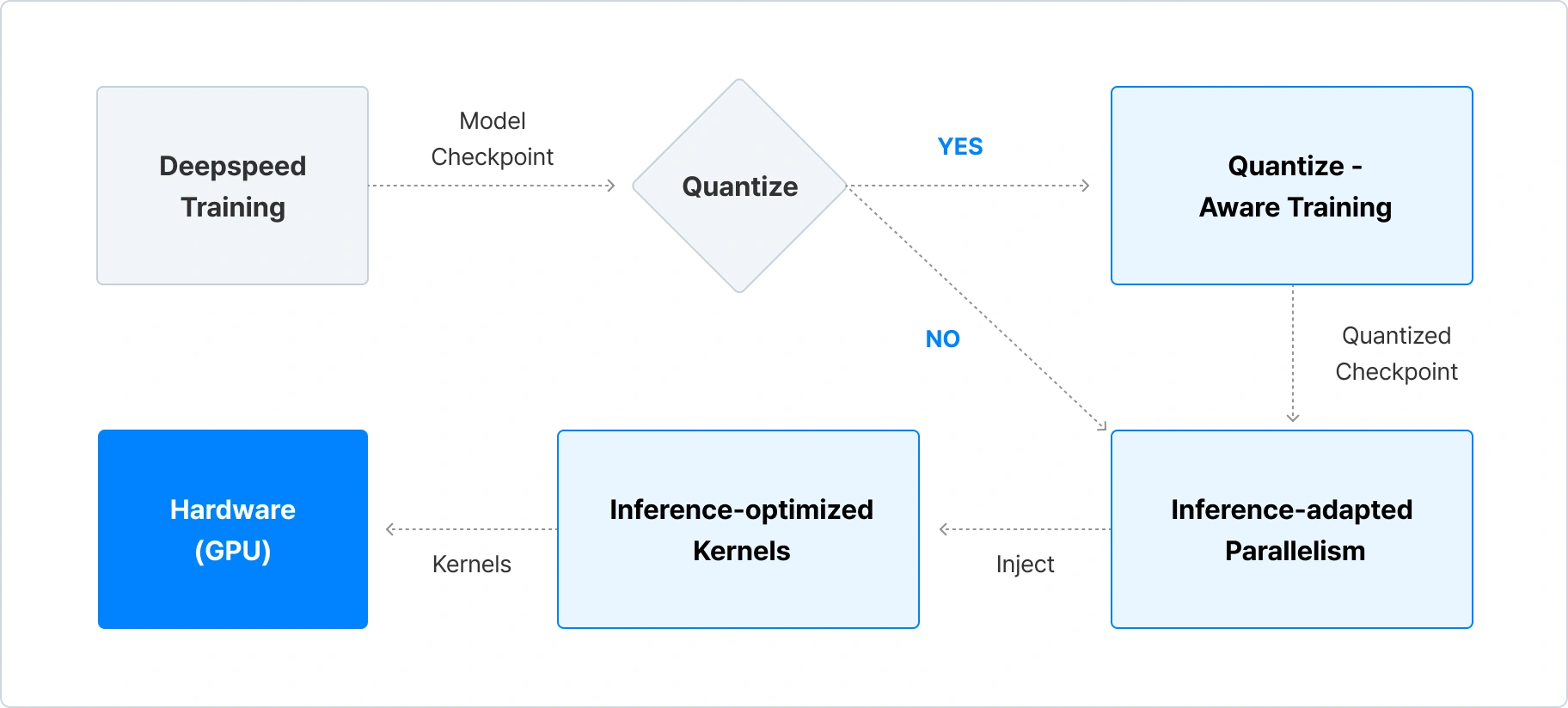

LLM의 응답 생성 속도를 올리는 방법 중

Deepspeed Inference에 대해 학습합니다.

Deepspeed Inference를 학습하면서 Latency와 비용을 최적화할 수 있는

기술 3가지의 원리를 배울 수 있습니다!

Point 4

빠른 AI 어플리케이션 제작

딥러닝 기반 프로토타입 툴인 Gradio를 이용하여

Instruction tuning 데이터를 직접 구축하고 나만의 ChatGPT 모델을 구성합니다.

Instruction Tuning 데이터를 수집 & 학습하여 사용자의 지시를 잘 따르고

여러 문제를 풀 수 있는 일반화 능력이 높은 챗봇을 구성할 수 있습니다.

궁금한 내용은 언제든 디스코드 질의응답 채널에 질문하세요!

현직 LLM(Large Language Model) 엔지니어가 직접 답변 드립니다!

수업 실습 환경

별도의 개발 지식 없이 사용할 수 있는 Google Colab Pro(유료 버젼, 과금 지원 불가합니다)를 활용하여 실습이 진행됩니다.

Hugging Face 라이브러리를 활용하여 실습이 진행됩니다.

선수지식이 있을까요?

언어모델에 대한 이해가 필요합니다.

• Pytorch 프레임워크 사용법의 이해가 필요합니다.

강사님 소개

Liam 강사님

[이력]

현) 국내 IT 대기업 엔지니어

프로젝트 및 연구 경력

• Open Domain Question Answering을 위한 IR, MRC 모델 개발

• PLM(Pretrained Language Model) 개발

• Task-Oriented Dialogue System 개발

커리큘럼

비용을 줄이는 LLM(대규모 언어 모델) Prompt Tuning

-

상세 커리큘럼.

자세한 커리큘럼 및 내용은 여기서 확인하세요!